-

1 mutual information

mutual information Wechselinformation f (Wahrscheinlichkeitslehre)English-German dictionary of Electrical Engineering and Electronics > mutual information

-

2 mutual information

Англо-русский словарь нормативно-технической терминологии > mutual information

-

3 mutual information

-

4 mutual information

Большой англо-русский и русско-английский словарь > mutual information

-

5 mutual information

-

6 mutual information

1) Техника: трансинформация2) Математика: взаимная информация3) Вычислительная техника: полное количество информации4) Программирование: количество взаимной информации -

7 mutual information

-

8 mutual information

Англо-русский словарь по компьютерной безопасности > mutual information

-

9 mutual information

English-Russian dictionary of computer science and programming > mutual information

-

10 mutual information

• prenášaná informácia -

11 mutual information

English-russian dctionary of contemporary Economics > mutual information

-

12 mutual information

-

13 mutual information

English-Russian big polytechnic dictionary > mutual information

-

14 mutual information

Англо-русский словарь по исследованиям и ноу-хау > mutual information

-

15 Mutual Information System on Social Protection

Mutual Information System on Social Protection (MISSOC) PERS Gemeinschaftliches Informationssystem n zur Sozialen Sicherheit in der Europäischen Union (EU)Englisch-Deutsch Fachwörterbuch der Wirtschaft > Mutual Information System on Social Protection

-

16 mutual information between two random-process segments

количество взаимной информации в отрезках случайных процессов

Мера уменьшения неопределенности отрезка случайного процесса, возникающего вследствие того, что становится известной реализация соответствующего отрезка другого случайного процесса, усредненного по реализациям последнего.

Примечания

1. Вместо термина «количество взаимной информации в отрезках случайных процессов» иногда употребляют выражение «количество информации об отрезке случайного процесса, содержащееся в отрезке другого случайного процесса».

2. Длина отрезка Т может иметь размерность, отличную от времени.

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Англо-русский словарь нормативно-технической терминологии > mutual information between two random-process segments

-

17 mutual information between two random variables

количество взаимной информации в случайных величинах

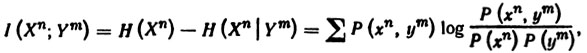

Мера уменьшения неопределенности случайной величины, возникающего вследствие того, что становится известным значение другой случайной величины, усредненного по знаниям последней; для дискретных случайных величин ее выражение имеет вид

где суммирование ведется по всему множеству значений хn, уm случайных величин Xn, ym; для непрерывных случайных величин ее выражение имеет вид

где интегрирование ведется по всему множеству значений xn, уm случайных величин Хn, Уm.

Примечания

1. Вместо термина «количество взаимной информации в случайных величинах» иногда употребляют выражение «количество информации о случайной величине, содержащееся в другой случайной величине».

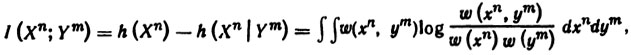

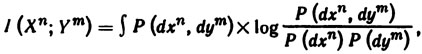

2. Общая форма математической записи выражения количества взаимной информации, справедливая в произвольном случае, имеет вид

где Р(хn, уm), Р(хn) и Р(уm) —вероятностные меры, заданные соответственно на множествах значений {хn, уm), хn и уm случайных величии (Xn, Уm), Хn и Уm.

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Англо-русский словарь нормативно-технической терминологии > mutual information between two random variables

-

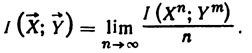

18 mutual information between two random sequence

количество взаимной информации в случайных последовательностях

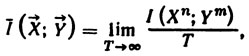

Отнесенное к единице времени количество информации в отрезке случайной последовательности относительно соответствующего отрезка другой случайной последовательности в пределе при стремлении к бесконечности длины отрезка; ее выражение имеет вид

где n и m —числа компонент последовательностей и

и  на длине отрезка T, а l (Хn; Уm)—количество взаимной информации в случайных величинах Хn и Уm.

на длине отрезка T, а l (Хn; Уm)—количество взаимной информации в случайных величинах Хn и Уm.

Примечания

1. Вместо термина «количество взаимной информации в случайных последовательностях» иногда употребляют выражение «количество информации о случайной последовательности, содержащееся в другой случайной последовательности».

2. Количество взаимной информации в случайных последовательностях, отнесенное к одной компоненте, имеет вид

3. Длина отрезка Т может иметь размерность, отличную от времени.

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Англо-русский словарь нормативно-технической терминологии > mutual information between two random sequence

-

19 mutual information between two random sequences

Универсальный англо-русский словарь > mutual information between two random sequences

-

20 mutual information between two random variables

Общая лексика: количество взаимной информации в случайных величинах (мера уменьшения неопределенности случайной величины, возникающего вследствие того, что становится известным значение другой случайной величины, усре), количество информации о случайной величине, содержащееся в другой случайной величине (мера уменьшения неопределенности случайной величины, возникающего вследствие того, что становится известным значение)Универсальный англо-русский словарь > mutual information between two random variables

См. также в других словарях:

Mutual information — Individual (H(X),H(Y)), joint (H(X,Y)), and conditional entropies for a pair of correlated subsystems X,Y with mutual information I(X; Y). In probability theory and information theory, the mutual information (sometimes known by the archaic term… … Wikipedia

Mutual Information — Transinformation oder gegenseitige Information ist eine Größe aus der Informationstheorie, die die Stärke des statistischen Zusammenhangs zweier Zufallsgrößen angibt. Die Transinformation wird auch als Synentropie bezeichnet. Im Gegensatz zur… … Deutsch Wikipedia

Conditional mutual information — In probability theory, and in particular, information theory, the conditional mutual information is, in its most basic form, the expected value of the mutual information of two random variables given the value of a third. Contents 1 Definition 2… … Wikipedia

Multivariate mutual information — In information theory there have been various attempts over the years to extend the definition of mutual information to more than two random variables. These attempts have met with a great deal of confusion and a realization that interactions… … Wikipedia

Quantum mutual information — In quantum information theory, quantum mutual information, or von Neumann mutual information, is a measure of correlation between subsystems of quantum state. It is the quantum mechanical analog of Shannon mutual information. Motivation For… … Wikipedia

Pointwise mutual information — (PMI) (or specific mutual information) is a measure of association used in information theory and statistics.The PMI of a pair of outcomes x and y belonging to discrete random variables quantifies the discrepancy between the probability of their… … Wikipedia

Mutual — may refer to: Mutual organization, where customers derive a right to profits and votes Mutual information, the intersection of multiple information sets Mutual insurance, where policyholders have certain ownership rights in the organization… … Wikipedia

Information theory — Not to be confused with Information science. Information theory is a branch of applied mathematics and electrical engineering involving the quantification of information. Information theory was developed by Claude E. Shannon to find fundamental… … Wikipedia

Information theory and measure theory — Measures in information theory = Many of the formulas in information theory have separate versions for continuous and discrete cases, i.e. integrals for the continuous case and sums for the discrete case. These versions can often be generalized… … Wikipedia

Information bottleneck method — The information bottleneck method is a technique introduced by Tishby et al [1] for finding the best tradeoff between accuracy and complexity (compression) when summarizing (e.g. clustering) a random variable X, given a joint probability… … Wikipedia

Information gain in decision trees — In information theory and machine learning, information gain is an alternative synonym for Kullback–Leibler divergence . In particular, the information gain about a random variable X obtained from an observation that a random variable A takes the … Wikipedia